Como o algoritmo das redes sociais sugere conteúdos impróprios para crianças e adolescentes

Ferramenta organiza o que aparece no feed dos jovens com base no comportamento de consumo

A repercussão nacional do vídeo em que o influenciador Felca denuncia casos de exploração infantil em conteúdos online levantou um debate sobre como funcionam os algoritmos — os códigos de computação que decidem quais conteúdos são exibidos para cada usuário. É possível "filtrar" o que as crianças veem nas redes sociais?

Essencialmente, os algoritmos de redes sociais identificam padrões de interesse e passam a recomendar conteúdos semelhantes para manter o usuário conectado pelo maior tempo possível. No caso de crianças e adolescentes, esse mecanismo pode ampliar a exposição a materiais impróprios, um dos riscos do uso irrestrito da internet. Especialistas garantem que a atenção que os jovens dedicam a determinadas postagens pode reforçar o ciclo de indicações nocivas.

Processando dados de comportamento do usuário, o algoritmo organiza o que aparece no feed com base no que já foi consumido, nas preferências, nas pessoas conhecidas e no que está em alta na rede. O objetivo é sugerir conteúdos que gerem engajamento e que façam com que o usuário passe mais tempo conectado a plataformas como YouTube, TikTok, Instagram, X e Kwai.

— Como tem muita informação, o algoritmo entra para fazer uma espécie de balanço entre o que deveria ser visto. É como se ele dissesse: "Aqui tem muita coisa, então você deve ver primeiro isso". O algoritmo tem essa habilidade, não existe nada aleatório — defende André Pase, professor da Escola de Comunicação, Artes e Design (Famecos) da Pontifícia Universidade Católica do Rio Grande do Sul (PUCRS) e membro do Observatório de Inteligência Artificial e Comunicações Móveis (Obiacom).

Os debates sobre como proteger crianças e adolescentes dos perigos da internet ganharam força após o vídeo do influenciador Felca, que repercutiu no país na última semana. Na publicação, o youtuber chamou atenção para os riscos da exposição online e denunciou casos de adultização e erotização de menores nas redes sociais.

O modo como os algoritmos funcionam pode aumentar a vulnerabilidade dos jovens no ambiente digital, segundo Pase:

— Essa coisa que o Felca trouxe nos faz pensar o que é nossa responsabilidade. O quanto nós também não treinamos o algoritmo, confiamos nele e ficamos confortáveis na história do algoritmo? Colocamos muito a culpa no algoritmo, mas também temos que olhar para a outra parte da história, que é quem dá atenção.

Conteúdos impróprios

Conteúdos com discurso de ódio, pornografia, preconceito, que estimulem dúvidas quanto à autoimagem ou episódios de automutilação, desafios perigosos e bullying são exemplos de materiais considerados problemáticos ou impróprios para menores. Para cérebros em desenvolvimento, como os de crianças e adolescentes, essas publicações podem influenciar comportamentos e percepções.

Para Thiago Roza, psiquiatra e professor da Universidade Federal do Paraná (UFPR), crianças e adolescentes são mais vulneráveis e têm tendência a buscar as gratificações imediatas proporcionadas pelo uso das redes sociais, como a liberação de dopamina e outras sensações que o cérebro associa ao consumo constante de conteúdo.

— Esses conteúdos despertam interesse porque desencadeiam emoções fortes na criança e no adolescente, sejam positivas ou negativas. Vamos supor que um menino esteja pesquisando algo relacionado à masculinidade. Daqui a pouco, vai ter algo relacionado à misoginia e a conteúdos extremistas porque o algoritmo entendeu que essas são coisas consumidas em conjunto. Imagine que o menino tenha sofrido uma rejeição, tenha essa dor emocional e veja alguém defendendo que isso é culpa do feminismo, disso e daquilo. É emocionalmente carregado e validante para eles — explica Roza.

O especialista observa que meninos e meninas são impactados de formas distintas. Para elas, por exemplo, conteúdos que falam mal dos homens, que promovem padrões de beleza inatingíveis, dietas exóticas ou questões de autoimagem podem ser validantes.

Conteúdos podem ser validantes para ambos os sexos.Africa Studio / stock.adobe.com

— Tanto meninos quanto meninas são vulneráveis por causa da imaturidade. O circuito da recompensa interage de forma semelhante. Mas acho que um discurso red pill (misógino), por exemplo, jamais interessaria a menina típica, enquanto, para alguns meninos, pode parecer interessante — acrescenta o especialista.

Ao se identificar com a publicação, é normal que os jovens assistam ao vídeo inteiro, curtam, comentem e compartilhem, o que indica para os algoritmos que aquele tipo de material é relevante para aqueles usuários.

É possível burlar o algoritmo?

Ferramentas de controle parental podem ajudar a minimizar os efeitos do algoritmo ao filtrar palavras-chave ou limitar o tempo de uso. Ainda assim, como pontua Pase, da PUCRS, a eficácia dessas medidas depende do comportamento do usuário, já que qualquer interação com conteúdos impróprios pode reforçar as recomendações feitas pelas plataformas.

— Em um mundo que tem muita informação e coisas acontecendo, precisamos do algoritmo (para selecionar conteúdos). Não podemos confiar demais nele, deixar que ele dirija, mas temos que conviver com ele — enfatiza o professor.

Pase afirma que não é possível burlar o algoritmo, mas sim treiná-lo. Os usuários podem interagir apenas com os conteúdos desejados, por tempo, por meio de curtidas, comentários e compartilhamentos. Se os conteúdos indesejados aparecerem, devem ser ignorados.

As plataformas conseguem barrar parte dos conteúdos mais explícitos e atuar de acordo com filtros definidos pelo controle parental. Outras situações, conforme o professor, escapam do controle, seja porque exigiriam análise humana em larga escala, seja porque entram em conflito com os interesses das próprias empresas:

— É interessante para as plataformas ser coniventes com isso. Porque essa conivência da plataforma é o que permite que essas contas (que publicam conteúdos impróprios) tenham engajamento. As plataformas falam que para moderar mais, vai precisar gastar muito e vai ser complicado.

Fonte: Gaúcha ZH

Foto: Jordi Salas / stock.adobe.com

Outras notícias

-

Auto Pratense doa R$ 50 mil em material de construção ao HSJB

Nesta terça-feira, 05 de maio, a diretoria e a administração do Hospital São João Batista receberam os representantes da empresa Auto Pratense, Gabriele e Daniele Colla e Bruno Romanzini, para formalizar a doaç&a ...

Saiba Mais -

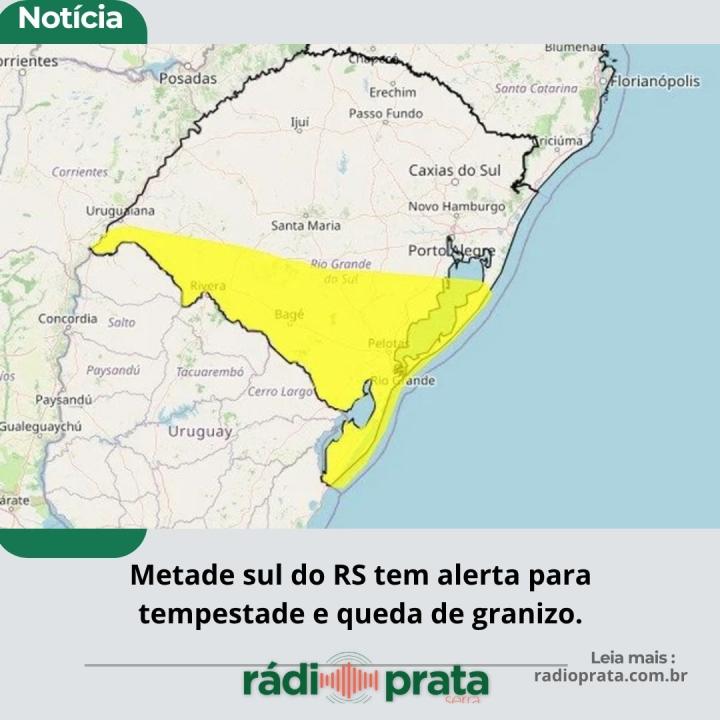

Alerta para tempestade e queda de granizo

Com grau de severidade amarelo, entra em vigor às 10h desta terça-feira (5) alerta de tempestade emitido pelo Instituto Nacional de Meteorologia (Inmet) para a metade sul do Rio Grande do Sul. O comunicado abrange a Região Sul, Ca ...

Saiba Mais